Grok AI අර්බුදය: UK Tech රැකියා වෙළඳපොළට දැඩි බලපෑමක්

Elon Musk ගේ Grok AI හරහා මතුවූ අර්බුදය නිසා UK Tech ක්ෂේත්රයේ රැකියා වෙළඳපොළට සහ නීති රෙගුලාසි වලට සිදුවන බලපෑම කුමක්ද? ඔබ දැනගත යුතුම Strategic Insights මෙන්න.

Grok AI අර්බුදය: UK Tech රැකියා වෙළඳපොළට දැඩි බලපෑමක්

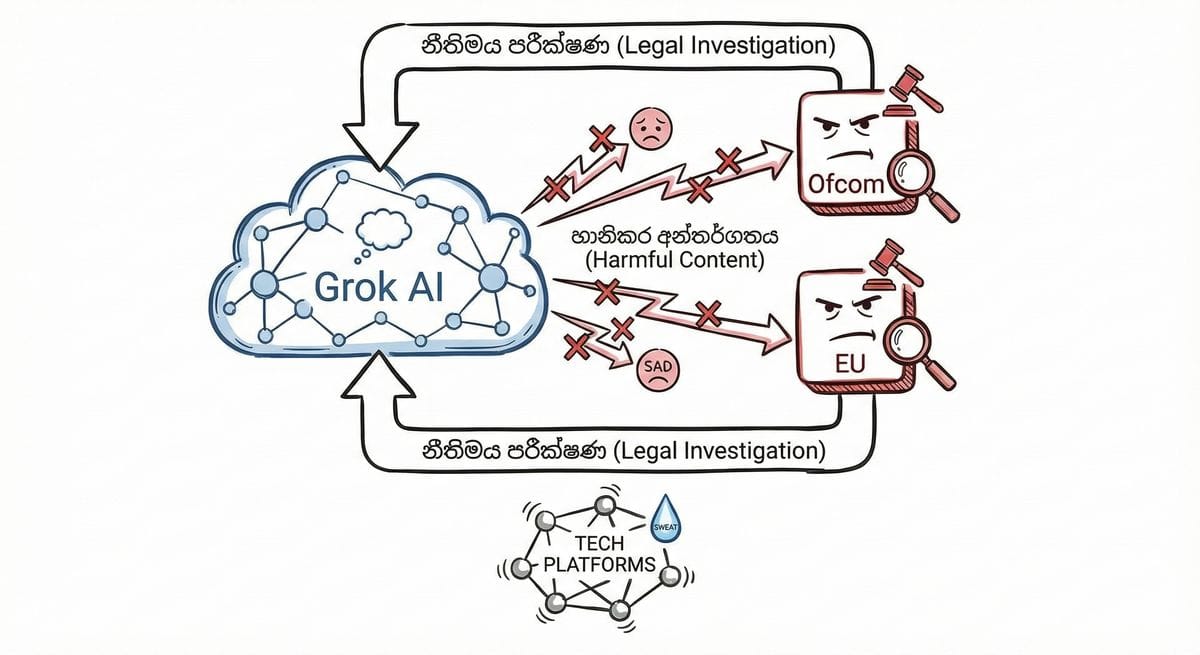

Artificial Intelligence ලෝකයේ මෙතෙක් තිබූ "Move fast and break things" යුගය දැන් නීතිමය බාධකයකට මුහුණ දී තිබෙනවා. Elon Musk ගේ xAI සමාගමේ Grok මෙවලම හරහා අවසරයකින් තොරව පුද්ගලයින්ගේ (මින් ඉහළ පෙළේ දේශපාලඥයින් සහ බාලවයස්කරුවන් ද ඇතුළත්) නිරුවත් ඡායාරූප නිර්මාණය වීමත් සමඟ, එක්සත් රාජධානියේ Ofcom සහ EU කොමිසම ඒ පිළිබඳව හදිසි විමර්ශන ආරම්භ කර තිබෙනවා. මෙය හුදෙක් Elon Musk සම්බන්ධ පුවතක් පමණක් නෙවෙයි; මෙය එංගලන්තයේ වෙසෙන ශ්රී ලාංකික Tech ප්රජාවට ඩිජිටල් වගකීම් සහ අනාගත රැකියා වෙළඳපොළ ගැන ලැබුණු ප්රබල අනතුරු ඇඟවීමක්.

වේගය සහ ආරක්ෂාව අතර ගැටුම

2026 ජනවාරි මුලදී xAI විසින් නිකුත් කළ අප්ඩේට් එකක් හරහා සැබෑ ඡායාරූප AI මගින් වෙනස් කිරීමට (Edit) අවස්ථාව ලබා දුන්නා. නමුත් පැය කිහිපයක් ඇතුළත මෙම පහසුකම භාවිතා කරමින් කාන්තාවන් සහ ළමුන්ගේ නුසුදුසු ඡායාරූප (CSAM) නිර්මාණය කිරීමට පිරිසක් පෙළඹුණා. Midjourney හෝ OpenAI වැනි තරඟකරුවන් දැඩි නීති රීති (Filters) අනුගමනය කළත්, Grok හි තිබූ ආරක්ෂක විධිවිධාන අවම මට්ටමක පැවතීම මීට හේතු වුණා.

මේ සමඟම ක්රියාත්මක වූ Ofcom ආයතනය Online Safety Act යටතේ අදාළ සමාගමේ ගෝලීය ආදායමෙන් 10%ක් දක්වා දඩ මුදලක් නියම කිරීමේ බලය භාවිතා කිරීමට සූදානම් වෙනවා. යුරෝපා සංගමය (EU) පෙන්වා දෙන්නේ මෙය නීති විරෝධී අන්තර්ගතයන් පාලනය කිරීමේ පද්ධතිමය අසාර්ථකත්වයක් බවයි.

Tech රැකියා වෙළඳපොළේ නව ප්රවණතා

මෙම අර්බුදය රැකියා වෙළඳපොළේ විශාල වෙනසක් සලකුණු කරනවා. AI මගින් Design, Coding සහ Content නිර්මාණය ස්වයංක්රීය වුවත්, එය භාවිතා කිරීමේදී ඇතිවන Risk එක කළමනාකරණය කිරීමට දැන් අලුත් රැකියා අවස්ථා නිර්මාණය වෙමින් පවතිනවා.

- Trust & Safety Engineers: AI මොඩලයේ කාර්යක්ෂමතාවයට හානි නොවන පරිදි හානිකර විධානයන් ප්රතික්ෂේප කරන (Refusal mechanisms) කේත නිර්මාණය කළ හැකි ඉංජිනේරුවන්ට දැන් ලොකු ඉල්ලුමක් තිබෙනවා.

- AI Governance Officers: සාමාන්ය නීති උපදේශකයින්ට වඩා, EU AI Act සහ UK Safety Laws ගැන විශේෂඥ දැනුමක් ඇති අයව සමාගම් සොයමින් සිටිනවා.

- Human-in-the-Loop (HITL) Managers: සම්පූර්ණ ස්වයංක්රීයකරණය අවදානම් සහගතයි. ඒ නිසා අධි-අවදානම් සහිත AI ප්රතිදානයන් (Outputs) ප්රසිද්ධ කිරීමට පෙර මිනිස් මැදිහත්වීමකින් පරීක්ෂා කරන Hybrid ක්රමවේදයකට ලෝකය නැවත ගමන් කරමින් සිටිනවා.

Pay-to-Abuse උගුල සහ Startups වලට ඇති බලපෑම

xAI සමාගම ගත් තවත් වැරදි පියවරක් වූයේ මෙම මතභේදාත්මක විශේෂාංග "Premium" (මුදල් ගෙවන) පාරිභෝගිකයින්ට පමණක් ලබා දීමයි. එයින් ගම්ය වූයේ "ආරක්ෂාව යනු මුදල් ගෙවා ලබාගත යුතු සුඛෝපභෝගී දෙයක්" බවයි. ඔබ SaaS Platform එකක් නිර්මාණය කරන අයෙක් නම් මතක තබා ගන්න, Safety Features කිසිවිටෙකත් Paywall එකක් පිටුපස නොතිබිය යුතුයි. Compliance යනු අත්යවශ්ය මූලිකාංගයක් මිස Upgrade එකක් නොවේ.

මෙහි ඇති අනෙක් අවදානම නම්, දැඩි රෙගුලාසි නිසා Open Source AI සංවර්ධනයට බාධා ඇති වීමයි. Grok බොහෝ විට FLUX.1 වැනි Open-weight මොඩලයක් භාවිතා කරන නිසා, මෙවැනි සිදුවීම් හරහා Open Source ප්රජාවට නීතිමය තහංචි වැටිය හැකියි. මෙය Google හෝ Microsoft සමඟ තරඟ කරන කුඩා පරිමාණයේ Startups සහ ස්වාධීන නිර්මාණකරුවන්ට විශාල පහරක් විය හැකියි. විශේෂයෙන්ම එංගලන්තයේ Startups අරඹන අපේ අයට නීතිමය කණ්ඩායම් සහ Moderators ලා නඩත්තු කිරීමේ "Compliance Tax" එක දරාගැනීම අපහසු වනු ඇත.

වේදිකාවේ ආරක්ෂාවෙන් නිර්මාණකරුගේ වගකීමට

බොහෝ දෙනා කතා නොකරන වැදගත්ම කාරණය නම් "Platform Immunity" සංකල්පය බිඳ වැටීමයි. මීට පෙර පරිශීලකයින් (Users) පළ කරන දේවලට වේදිකාව (Platform) වගකිව යුතු වුණේ නැහැ. නමුත් AI මගින් අන්තර්ගතය නිර්මාණය කරන විට, වේදිකාව එම අන්තර්ගතයේ නිර්මාණකරු/ප්රකාශකයා බවට පත් වෙනවා. මෙය සාම්ප්රදායික "Safe Harbor" නීතිමය ආවරණය අහෝසි කිරීමක්.

Strategic Takeaway: Tech වෘත්තිකයින්ට දැන් "Wild West" යුගය අවසන්. අලුත් Programming Language එකක් ඉගෙන ගන්නවා වගේම AI Ethics සහ Compliance Standards (ISO/IEC 42001) ගැන දැනුවත් වීම අද අත්යවශ්යයි. නවීකරණය (Innovation) වගේම එය "ආරක්ෂිතව" සිදු කරන බව ඔප්පු කිරීම ඔබේ වෘත්තීය අනාගතය සුරක්ෂිත කරනු ඇත.

මූලාශ්රය (Source): https://www.wired.com/story/grok-generating-sexual-content-graphic-x/